人工智能

用天文技术来识别AI“深度伪造”肖像

通过分析眼中的光线反射,研究人员正借助天文技术来帮助识别计算机生成的“深度伪造”(Deepfake)图像——这些图像乍一看与真实照片几乎无异。

天文学家们通过使用通常用于观测遥远星系的方法来分析脸部图像,可以测量一个人眼睛反射光线的方式,从而揭示图像被操纵的迹象。

英国赫尔大学数据科学、人工智能与建模卓越中心主任Kevin Pimbblet在7月15日的英国皇家天文学会全国天文学会议上展示了这项研究,他表示:“这不是灵丹妙药,因为我们确实有误报和漏报。但这项研究提供了一种潜在的方法,也许可以作为试图辨别图像真伪的一系列测试中的重要补充。”

伪造照片

人工智能(AI)的进步使得区分真实图像、视频和音频与由算法生成的伪造图像变得越来越困难。深度伪造技术可以将一个人或环境的特征替换为另一个人的特征,并使之看起来像是某人说了或做了实际上并没有发生的事情。有关部门警告称,这项技术可能被用作武器,传播虚假信息,例如在选举期间。

Pimbblet解释道,真实照片应该具有“一致的物理特性”,“所以你在左眼球中看到的反光应该与右眼球中的反光非常相似,尽管不一定完全相同”。这些差异非常微妙,因此研究人员转向了用于分析天文图像中光线的技术。

这项尚未发表的工作是Adejumoke Owolabi硕士论文的基础。Owolabi是英国赫尔大学的一名数据科学家,她从Flickr-Faces-HQ数据集中获取了真实图像,并使用图像生成器创建了假脸。然后,Owolabi使用两种天文测量方法分析了图像中眼睛中的光源反射:CAS系统和Gini指数。CAS系统量化了物体光分布的集中度、不对称性和平滑度。这项技术几十年来一直允许包括Pimbblet在内的天文学家对银河系外恒星的光进行特征描述。Gini指数则衡量了图像中光分布的不均匀性。

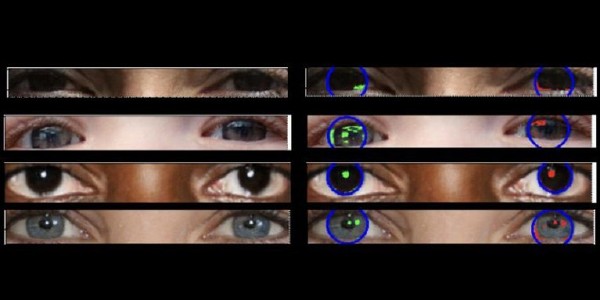

Deepfake图像中的眼睛(左)具有不一致的反射模式(右)。

通过比较个体眼球中的反光,Owolabi能够在大约70%的情况下正确预测图像是否为伪造。最终,研究人员发现Gini指数比CAS系统更能预测图像是否被操纵。

加州大学圣克鲁兹分校的天体物理学家Brant Robertson对这项研究表示欢迎。然而,他警告说:“如果你能计算出一个量化深度伪造图像逼真程度的指标,你也可以通过优化这个指标来训练AI模型生成更好的深度伪造图像。”

英国南安普顿大学的人工智能研究员Zhiwu Huang表示,他自己的研究并没有在深度伪造图像中发现眼部光线模式的不一致性。但他说:“尽管使用眼球反光不一致的特定技术可能不具有广泛适用性,但此类技术可能对分析图像不同部分的微妙异常光线、阴影和反射有用。检测光线物理特性中的不一致性可能会补充现有方法,并提高深度伪造检测的整体准确性。”